歸藏(guizang.ai)

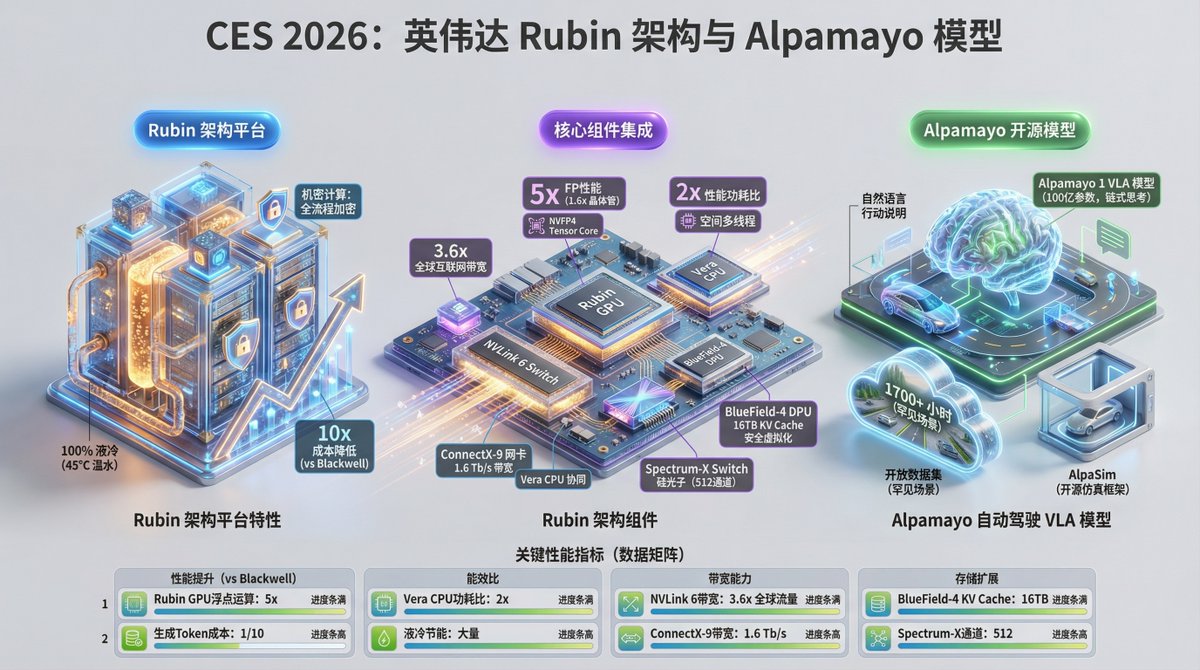

@op7418 · 1周前昨晚 CES 2026 老黄照例发表演讲,总结一下发布内容

主要是升级的 Rubin 芯片架构和 Alpamayo 机器人和自动驾驶 VLA 模型

------

Rubin 架构平台特性:

100% 液冷: 使用 45°C 的温水冷却,无需冷水机组,节省大量能源;

机密计算: 所有数据在传输、静态和计算过程中均加密;

性能飞跃: 在训练 10 万亿参数模型时,Rubin 的吞吐量大幅提升,且生成 Token 的成本仅为 Blackwell 的十分之一;

Rubin 架构主要有下面几个部分组成:

Vera CPU: 专为功率受限环境设计,性能功耗比是前代的 2 倍,采用空间多线程技术。

Rubin GPU:浮点运算性能是 Blackwell 的 5 倍,但晶体管数量仅增加 1.6 倍。引入了 NVFP4 Tensor Core,一种能够动态调整精度的处理单元。

NVLink 6 Switch: 交换机芯片带宽达到 3.6 倍全球互联网总流量,确保每个 GPU 都能同时与所有其他 GPU 通信。

ConnectX-9 网卡: 与 Vera CPU 协同设计,提供 1.6 Tb/s 的带宽。

BlueField-4 DPU:负责安全性及虚拟化,它还引入了革命性的 KV Cache 存储功能,解决了长上下文对话中 GPU 显存不足的问题,为每个 GPU 额外提供 16TB 的快速访问内存。

Spectrum-X Ethernet Switch(新一代):

采用硅光子技术和共封装光学器件,拥有 512 个通道。

------

开源 Alpamayo 模型家族:

Alpamayo 1 VLA 模型:100亿参数的“链式思考”视觉-语言-行动模型,能把问题分解为步骤、在多方案中推理并选择更安全的路径,并用自然语言说明行动与轨迹。

开放数据集:包含超过 1700 小时的驾驶数据,这些数据涵盖了各种地理区域和路况,囊括了罕见且复杂的真实世界场景。

AlpaSim:一个用于验证自动驾驶系统的开源仿真框架。

6

5

58

27

16